[선형변환부터 동형사상까지] ch1. 선형변환

이전 읽을거리 : [선형변환부터 동형사상까지] ch0. 함수

다음 읽을거리 : [선형변환부터 동형사상까지] ch2. 선형변환의 존재성 및 유일성

본 포스팅은 '프리드버그 선형대수학(5판)'을 공부하며 작성하였습니다.

1. 선형변환

선형변환의 정의는 추상적이지만, 그 덕분에 실제로 많은 것이 선형변환에 속하게 된다. 추상적인 공부를 할 때는, 지금 공부하는 것들이 나중에 반드시 구체화될 것이라는 믿음이 도움이 된다.

선형변환이 쓸모 있는 것 중 하나는, 행렬을 함수처럼 자연스럽게 쓸 수 있게 된다는 것이다. 행렬의 오른쪽에 열벡터를 곱하면 또다른 열벡터가 나오는걸 생각하면 어떤 느낌인지 알 것이다. 이러한 느낌을 잡아둔 채, 선형변환의 정의를 보자.

정의) 두 $F$-벡터공간 $V$ 와 $W$ 를 생각하자. 모든 $x,\;y\in V$ , $c\in F$ 에 대하여 다음을 만족하는 함수 $T:V\to W$ 를 $V$ 에서 $W$ 로 가는 선형변환(linear transformation)이라 한다.

(ⅰ) $T(x+y)=T(x)+T(y)$

(ⅱ) $T(cx)=cT(x)$

선형변환의 정의를 말로 풀어서 설명하면 다음과 같다.

(ⅰ) 더한 것의 결과는 결과를 더한 것과 같다.

(ⅱ) 몇배 한 것의 결과는 결과를 몇배 한 것과 같다.

즉, 두 벡터의 합과 스칼라 곱에 대해서는 선형변환을 통과하기 전/후 언제 연산하던지 그 값은 같다는 것이다.

'어떤 함수가 선형변환이다' 라는 말 대신에 '어떤 함수가 선형(linear)이다' 라고 할 수 있다. 혹자는 선형변환이라는 말 대신에 선형사상이라는 용어를 쓰기도 한다.

1.1. 선형변환의 기본성질

어떤 함수가 선형변환인 것을 알기 위해서는 원래 위 정의와 같이 두 가지 성질을 확인해야 했으나, 아래의 정리 1-1(ⅱ)에 따라 한 번만 확인하여도 된다.

정리 1.1-1) $F$-벡터공간 $V$ 와 $W$ 에서 정의된 함수 $T:V\to W$ 에 대하여 다음이 성립한다.

(ⅰ) $T$ 가 선형이면 $T(0)=0$ 이다.

(ⅱ) $T$ 가 선형이기 위한 필요충분조건은 모든 $x,\;y\in V$ , $c\in F$ 에 대하여 $T(cx+y)=cT(x)+T(y)$ 인 것이다.

(ⅲ) $T$ 가 선형이면 모든 $x,\;y\in V$ 에 대하여 $T(x-y)=T(x)-T(y)$ 이다.

(ⅳ) $T$ 가 선형이기 위한 필요충분조건은 모든 $x_1,\ldots,x_n\in V$ 와 $a_1,\ldots,a_n\in F$ 에 대하여 다음 식을 만족하는 것이다.$$T\left(\sum_{i=1}^n a_ix_i\right)=\sum_{i=1}^n a_iT(x_i)$$

proof)

(ⅰ) : $T$ 가 선형이면 임의의 벡터 $x\in V$ , 임의의 스칼라 $c\in F$ 에 대해 $T(cx)=cT(x)$ 가 성립한다. 특히 $c=0$ 일때 $0x=0\in V$ , $0T(x)=0\in W$ 이므로 $T(0)=0$ 이 성립한다.

(ⅱ) : $T$ 가 선형일 때를 생각하자. 모든 $x,\;y\in V$ , $c\in F$ 에 대하여 다음이 성립한다.

$$T(cx+y)=T(cx)+T(y)=cT(x)+T(y)$$

역으로 모든 $x,\;y\in V$ , $c\in F$ 에 대하여 $T(cx+y)=cT(x)+T(y)$ 가 성립한다고 하자. $c=1$ 일때 벡터공간의 정의 (VS5)에 따라 $1x=x$ , $1T(x)=T(x)$ 이므로 $T(x+y)=T(x)+T(y)$ 이다. $y=0$ 일때 벡터공간의 정의 (VS3)에 따라 $cx+0=cx$ 이고 (ⅰ)에 따라 $T(0)=0$ 이므로 $T(cx)=cT(x)$ 이다. $T$ 는 선형이기 위한 두 조건을 모두 만족하므로 선형이다.

(ⅲ) : $T$ 가 선형이면 (ⅱ)에 따라 $T(x+cy)=T(x)+cT(y)$ 이다. 특히 $c=-1$ 일때 $(-1)y=-y$ 이고 $(-1)T(y)=-T(y)$ 이므로 $T(x-y)=T(x)-T(y)$ 가 성립한다. (참조: [벡터공간부터 기저까지] 정리 1.4-1(ⅱ) )

(ⅳ) : $T$ 가 선형일 때를 생각하자. $n$ 에 대한 수학적 귀납법을 이용하자. $n=1$ 일때는 선형변환의 정의 (ⅱ)와 동일하므로 자명하게 성립한다. $n=m-1$ (단, $m\ge2$) 일때 본 정리가 참이라고 가정하자. 즉, 다음 식이 참이다.

$$T\left(\sum_{i=1}^{m-1} a_ix_i\right)=\sum_{i=1}^{m-1}a_iT(x_i)$$

다음이 성립한다.

$$\mbox{let, }z=\sum_{i=1}^{m-1}a_ix_i$$

$$\begin{align}T\left(\sum_{i=1}^m a_ix_i\right)=&T\left(\sum_{i=1}^{m-1} a_ix_i+a_mx_m\right)\\=&T(z+a_mx_m)\\=&T(z)+a_mT(x_m)\\=&T\left(\sum_{i=1}^{m-1}a_ix_i\right)+a_mT(x_m)\\=&\sum_{i=1}^{m-1}a_iT(x_i)+a_mT(x_m)\\=&\sum_{i=1}^m a_iT(x_i)\end{align}$$

따라서 $n=m$ 일때도 본 정리가 참이다. 수학적 귀납법에 따라 임의의 음이 아닌 정수 $n$ 에 대하여 본 정리가 성립한다. $\square$

다음의 정리는 선형변환에 관련한 다양한 증명에 고루 사용되는 매우 유익한 사실을 담고있다.

정리 1.1-2) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. 부분집합 $S\subset V$ 에 대하여 다음이 성립한다.$$\mbox{span}(T(S))=T(\mbox{span}(S))$$

※ 집합의 상에 대한 표기법은 [선형변환부터 동형사상까지] 0. 함수 참조

proof)

편의상 $S=\{x_1,x_2,\ldots,x_n\}$ 이라고 하자. 이때 $T(S)=\{T(x_1),T(x_2),\ldots,T(x_n)\}$ 이다. 집합 $\mbox{span}(T(S))$ 의 임의의 원소 $y$ 와 적절한 스칼라 $a_1,\ldots,a_n$ 에 대하여 다음이 성립한다.

$$\begin{align}y=&a_1T(x_1)+a_2T(x_2)+\cdots+a_nT(x_n)\\=&T(a_1x_1+a_2x_2+\cdots+a_nx_n)\end{align}$$

이때 $a_1x_1+\cdots+a_nx_n\in\mbox{span}(S)$ 이므로 $y\in T(\mbox{span}(S))$ 이다. 따라서 $\mbox{span}(T(S))\subset T(\mbox{span}(S))$ 가 성립한다.

집합 $T(\mbox{span}(S))$ 의 임의의 원소 $z$ 는 적절한 스칼라 $b_1,\ldots,b_n$ 에 대하여 다음이 성립한다.

$$\begin{align}z=&T(b_1x_1+b_2x_2+\cdots+b_nx_n)\\=&b_1T(x_1)+b_2T(x_2)+\cdots+b_nT(x_n)\end{align}$$

그러므로 $z\in \mbox{span}(T(S))$ 이며 $T(\mbox{span}(S))\subset\mbox{span}(T(S))$ 가 성립한다. 정리하면 $\mbox{span}(T(S))=T(\mbox{span}(S))$ 를 얻는다. $\square$

1.2. 선형변환의 예

1.2.1. x축으로 사영

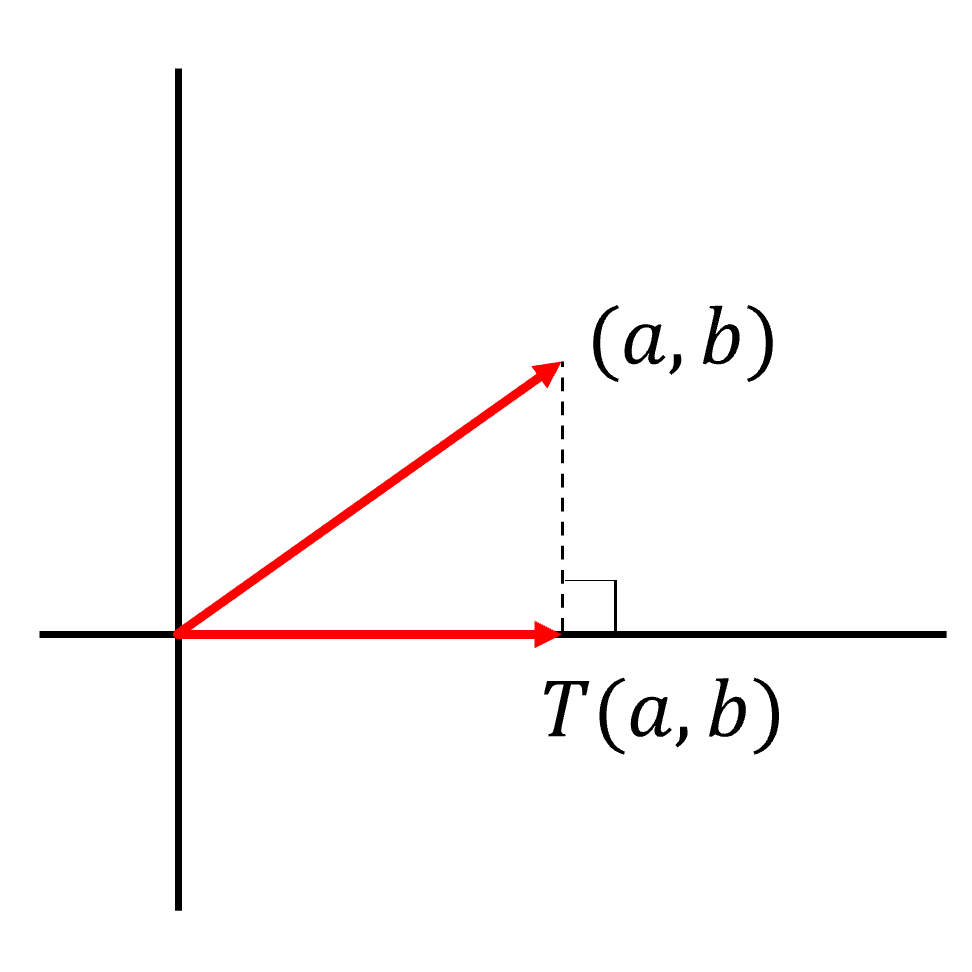

함수 $T:\mathbb{R^2\to R^2},\;(x,y)\mapsto(x,0)$ 을 생각하자. $T$ 는 'x축으로 사영'이라고 한다. 이 함수에 이런 이름이 붙은 이유는 위 그림을 보면 직관적으로 알 수 있다. 다음의 증명에 따라 x축으로 사영은 선형변환이다.

proof)

정리 1.1-1(ⅱ)가 만족함을 보이면 된다. $x=(a_1,a_2),\;y=(b_1,b_2)$ 라고 하자. 스칼라 $c$ 에 대해 다음이 성립한다.

$$\begin{align}T(cx+y)=&T(c(a_1,a_2)+(b_1,b_2))\\=&T(ca_1+b_1,ca_2+b_2)\\=&(ca_1+b_1,0)\\=&c(a_1,0)+(b_1,0)\\=&cT(a_1,a_2)+T(b_1,b_2)\\=&cT(x)+T(y)\end{align}$$

x축으로 사영이 정리 1.1-1(ⅱ)를 만족하므로 이는 선형변환이다. $\square$

1.2.2. x축 대칭

함수 $T:\mathbb{R^2\to R^2},\;(x,y)\mapsto(x,-y)$ 를 생각하자. $T$ 는 'x축 대칭'이라고 한다. 마찬가지로 위 그림을 참조하면 이런 이름이 붙은 이유를 알 수 있다. 다음의 증명에 따라 x축 대칭은 선형변환이다.

proof)

정리 1.1-1(ⅱ)가 만족함을 보이면 된다. $x=(a_1,a_2),\;y=(b_1,b_2)$ 라고 하자. 스칼라 $c$ 에 대해 다음이 성립한다.

$$\begin{align}T(cx+y)=&T(ca_1+b_1,ca_2+b_2)\\=&(ca_1+b_1,-ca_2-b_2)\\=&c(a_1,-a_2)+(b_1,-b_2)\\=&cT(a_1,a_2)+T(b_1,b_2)\\=&cT(x)+T(y)\end{align}$$

x축으로 사영이 정리 1.1-1(ⅱ)를 만족하므로 이는 선형변환이다. $\square$

1.2.3. 회전변환

2차원 평면의 벡터를 반시계방향으로 각도 $\theta$ (단위는 라디안)만큼 회전한 벡터를 상으로 갖는 함수 $T_\theta:\mathbb{R^2\to R^2}$ 를 생각하자. $T_\theta$ 는 각 $\theta$ 에 대응하는 회전변환이라고 한다. 이 함수는 선형변환이며 구체적으로 다음과 같다.

$$T_\theta(a,b)=(a\cos\theta-b\sin\theta,a\sin\theta+b\cos\theta)$$

회전변환이 어떻게 위와 같이 써질 수 있는지는 후에 다룰 것이다. 회전변환이 선형변환임을 증명하는 것은 위의 두 선형변환과 마찬가지로 매우 쉬우나, 인터넷 수식으로 적기에는 좌우로 너무 길어져서 그 증명은 생략한다. 각자가 스스로 해보시길 바란다.

1.2.4. 미분

무한 번 미분가능한 함수 $f:\mathbb{R\to R}$ 의 집합을 $V$ 라 하자. $V$ 가 $\mathbb{R}$-벡터공간이라는 것은 함수공간 $\mathcal{F}(\mathbb{R,R})$ 의 부분공간임을 보이면 충분하다. (참고: [벡터공간부터 기저까지] 1.2.3. 함수 ) 다음과 같이 함수를 정의하자.

$$T:V\to V,\;f\mapsto f'$$

이 함수는 주어진 미분가능한 함수를 그저 한 번 미분하는 함수로서, 다음의 증명에 따라 선형변환임을 쉽게 알 수 있다.

proof)

미분가능한 두 함수 $f,\;g\in V$ 와 스칼라 $a\in\mathbb{R}$ 에 대하여 다음이 성립한다.

$$T(af+g)=(af+g)'=af'+g'=aT(f)+T(g)$$

정리 1.1-1(ⅱ)에 따라 $T$ 는 선형변환이다. $\square$

1.3. 특별한 선형변환

다음의 두 변환은 상당히 자주 사용되는 함수이다.

정의) $F$-벡터공간 $V,\;W$ 를 생각하자.

▶ 항등변환(Identity transformation)은 다음과 같이 정의된다.$$I_V:V\to V,\;x\mapsto x$$ ▶ 영변환(zero transformation)은 다음과 같이 정의된다.$$0:V\to W,\;x\mapsto 0\in W$$

다시말해, 항등변환은 벡터공간의 벡터를 동일한 벡터공간의 동일한 벡터로 보내는 함수이며 영변환은 한 벡터공간의 모든 벡터를 다른 벡터공간의 영벡터로 보내는 함수이다. 항등변환의 하첨자는 항등변환이 정의된 벡터공간을 명시하기 위한 목적으로 작성되며, 정의된 벡터공간을 밝힐 필요가 없을 때는 간단히 $I$ 라고 적기도 한다.

항등변환과 영변환은 모두 선형변환이다. 자명한 사실이지만, 한 번 쯤은 증명해보는 것도 나쁘지 않다.

2. 영공간과 상공간

이번 절에서 소개하는 두 부분공간은 선형대수학에서 절대 빠질 수 없을 정도로 중요하다. 선형변환을 알기 위해서는 이를 반드시 알고 가야한다.

정의) 벡터공간 $V,\;W$ 와 임의의 선형변환 $T:V\to W$ 를 생각하자.

▶ 영공간(null space, kernel)은 $T$ 에 대한 상이 0인 $V$ 의 모든 벡터의 집합이며 $N(T)$ 라 표기한다. 집합으로 나타내면 다음과 같다.$$N(T):=\{x\in V:T(x)=0\}$$ ▶ 상공간(range, image)은 $T$ 의 모든 함숫값의 집합이며 $R(T)$ 라 표기한다. 집합으로 나타내면 다음과 같다.$$R(T):=\{T(x):x\in V\}$$

비유하자면 영공간은 영벡터로 가는 모든 출발지의 집합, 상공간은 가능한 모든 도착지의 집합인 것이다. 영공간은 정의역인 벡터공간 $V$ 의 부분집합, 상공간은 공역인 벡터공간 $W$ 의 부분집합이다.

위에서 소개한, 좌표평면에서 정의되는 x축 사영 변환을 생각하자. y축 위의 모든 벡터는 변환을 거쳐 원점으로 가고, 좌표평면의 모든 벡터는 변환을 거쳐 x축 위에 놓여지게 된다. y축 위의 벡터 외에는 변환으로써 원점으로 가는 벡터가 없다는 사실을 추가하면 x축 사영의 영공간은 y축, x축 사영의 상공간은 x축임을 알 수 있다.1

사실 상공간 대신에 우리는 더 친숙한 용어인 '치역'을 사용할 수 있다. 그럼에도 불구하고 굳이 상공간이라고 부르는 이유는, 후술할 이유에 따라 상공간이 공역의 부분공간임을 강조하기 위해서이다.2

정리 2-1) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. $N(T),\;R(T)$ 는 각각 $V,\;W$ 의 부분공간이다.

proof)

혼란을 방지하기 위해 $V,\;W$ 의 영벡터를 각각 $0_V,\;0_W$ 라 표기하자. $N(T),\;R(T)$ 가 각각 $V,\;W$ 의 영벡터를 포함하며 합과 스칼라 곱에 대해 닫혀있음을 보이면 된다. (참고: [벡터공간부터 기저까지] 2.1. 부분공간의 정의)

정리 1.1-1(ⅰ)에 따라 $T(0_V)=0_W$ 이므로 $0_V\in N(T)$ 이다. 두 벡터 $x,\;y\in N(T)$ 와 스칼라 $c\in F$ 에 대해 다음이 성립한다.

$$\begin{align}T(x+y)&=T(x)+T(y)\\&=0_W+0_W=0_W\end{align}$$

$$\therefore x+y\in N(T)$$

$$T(cx)=cT(x)=c0_W=0_W$$

$$\therefore cx\in N(T)$$

$N(T)$ 는 합과 스칼라 곱에 대해 닫혀있으므로, 정리하면 $N(T)$ 는 $V$ 의 부분공간이다.

정리 1.1-1(ⅰ)에 따라 $T(0_V)=0_W$ 이므로 $0_W\in R(T)$ 이다. 두 벡터 $u,\;v\in R(T)$ 에 대하여 $T(x)=u$ , $T(y)=v$ 를 만족하는 두 벡터 $x,\;y\in V$ 가 존재한다. 스칼라 $c\in F$ 에 대해 다음이 성립한다.

$$u+v=T(x)+T(y)=T(x+y)\in R(T)$$

$$cu=cT(x)=T(cx)\in R(T)$$

$R(T)$ 는 합과 스칼라 곱에 대해 닫혀있으므로, 정리하면 $R(T)$ 는 $W$ 의 부분공간이다. $\square$

2.1. 차원정리 (dimension theorem)

정리 2-1로부터 어떤 선형변환의 영공간과 상공간은 부분공간, 즉 벡터공간임을 알았다. 벡터공간은 반드시 기저를 포함하므로, 영공간과 상공간의 기저를 이루는 벡터의 수를 헤아려 각각의 차원을 이야기해볼 수 있다. (참고: [벡터공간부터 기저까지] 정리 7.2-2 )

정의) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. $N(T)$ 와 $R(T)$ 가 유한차원이면 다음이 정의된다.

▶ $N(T)$ 의 차원 $\mbox{dim}(N(T))$ 를 nullity라 하고, $\mbox{nullity}(T)$ 라 표기한다.

▶ $R(T)$ 의 차원 $\mbox{dim}(R(T))$ 를 rank라 하고, $\mbox{rank}(T)$ 라 표기한다.

이번 시리즈의 후반부에 정말 빈번하게 등장할 차원정리를 다뤄보기에 앞서, 다음 정리를 보자.

정리 2.1-1) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. $V$ 의 기저 $\beta$ 에 대하여 다음이 성립한다.$$R(T)=\mbox{span}(T(\beta))$$

proof)

$\beta$ 는 $V$ 를 생성하며, 상공간 $R(T)$ 는 선형변환 $T$ 의 치역이므로 $R(T)=T(V)=T(\mbox{span}(\beta))$ 가 성립한다. 정리 1.1-2에 따라 $T(\mbox{span}(\beta))=\mbox{span}(T(\beta))$ 가 성립하므로 $R(T)=\mbox{span}(T(\beta))$ 이다. $\square$

차원정리를 소개하기에 앞서, 하나의 직관을 발휘해보자. 어떤 선형변환에 대하여, 영벡터로 가버리는 출발지가 많을수록, 다른 도착지는 그 만큼 적을 것이다. 반대로 도착지가 다양하다는 것은 영벡터로 가는 출발지가 적다는 것이다. 이를 앞서 설명한 nullity와 rank로 다시말해, nullity가 커지면 rank가 줄어들고 rank가 커지면 nullity가 줄어든다고 예측할 수 있다.

차원정리) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. $V$ 가 유한차원이면 다음이 성립한다.$$\mbox{dim}(V)=\mbox{nullity}(T)+\mbox{rank}(T)$$

proof)

$V$ 의 차원 $\mbox{dim}(V)=n$ , $N(T)$ 의 차원 $\mbox{nullity}(T)=k$ 라 하고, $V$ 의 부분공간인 $N(T)$ 의 임의의 기저를 $\{v_1,\ldots,v_k\}$ 라 하자. 이 기저를 확장하여 $V$ 의 기저 $\beta=\{v_1,\ldots,v_k,v_{k+1}\ldots,v_n\}$ 을 얻을 수 있다. (참고: [벡터공간부터 기저까지] 대체정리의 따름정리 2(ⅲ) ) 이 확장된 만큼의 일차독립인 집합 $\{v_{k+1},\ldots,v_n\}$ 에 대하여 집합 $S=\{T(v_{k+1}),\ldots,T(v_n)\}$ 이 $R(T)$ 의 기저임을 보인다면 $\mbox{rank}(R(T))=n-k$ 이므로 차원정리가 성립한다.

정리 2.1-1에 따라 $R(T)=\mbox{span}(T(\beta))$ 이며, $\beta$ 의 원소 $v_1,\ldots,v_k$ 의 $T$ 에 대한 상은 영벡터이다. 영벡터가 포함된 집합은 그 집합에서 영벡터를 제거하여도 생성집합이 같으므로 다음이 성립한다.

$$\begin{align}&\quad R(T)\\&=\mbox{span}(T(\beta))\\&=\mbox{span}(\{T(v_1),\ldots,T(v_k),T(v_{k+1}),\ldots,T(v_n)\})\\&=\mbox{span}(\{0,T(v_{k+1}),\ldots,T(v_n)\})\\&=\mbox{span}(\{T(v_{k+1}),\ldots,T(v_n)\})\\&=\mbox{span}(S)\end{align}$$

따라서 $S$ 는 $R(T)$ 를 생성한다. 다음으로 $S$ 가 일차독립임을 보이자. $S$ 의 임의의 일차결합으로 영벡터를 표현한다고 하자. 어떤 스칼라 $a_{k+1},\ldots,a_n$ 에 대하여 다음과 같다.

$$0=\sum_{i=k+1}^na_iT(v_i)=T\left(\sum_{i=k+1}^na_iv_i\right)$$

이때 선형결합 $\sum_{i=k+1}^na_iv_i=y$ 라고 하자. $y$ 의 $T$ 에 대한 상이 영벡터이므로 $y\in N(T)$ 이다. 그러므로 어떤 스칼라 $b_1,\ldots,b_k$ 에 대하여 다음과 같이 $N(T)$ 의 기저로 $y$ 를 표현할 수 있다.

$$\begin{gather}y=b_1v_1+\cdots+b_kv_k\\\iff\sum_{i=1}^k(-b_i)v_i+\sum_{i=k+1}^na_iv_i=0\end{gather}$$

이는 $\beta$ 의 선형결합으로 영벡터를 표현한 것이므로 모든 스칼라는 0이어야 함을 알 수 있다. 즉, $S$ 의 일차결합으로 영벡터를 표현하는 방법은 자명한 방법이 유일하다. 따라서 $S$ 는 일차독립이므로 원하는 결과를 얻는다. $\square$

차원정리에 $V,\;N(T),\;R(T)$ 가 하나의 항등식에 쓰여있지만 $N(T)$ 는 $V$ 의 부분공간이고 $R(T)$ 는 $T$ 의 공역의 부분공간임에 주의하자.

2.2. 선형변환의 성질

이번에 소개되는 선형변환의 성질은 정말 많이 사용된다.

정리 2.2-1) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. $T$ 가 단사함수이기 위한 필요충분조건은 $N(T)=\{0\}$ 인 것이다.

※ 단사함수에 대해서는 0.1.1. 단사함수 참고

proof)

$T$ 가 단사함수일 때를 생각하자. 정리 1.1-1(ⅰ)로부터 $T(0)=0$ 이다. 어떤 벡터 $x\in V$ 에 대해 $T(x)=0$ 이라면 $T(x)=T(0)$ 이므로 정리 0.1.1-1에 따라 $x=0$ 이다. 그러므로 다음이 성립한다.

$$N(T)=\{x\in V:T(x)=0\}=\{0\}$$

$N(T)=\{0\}$ 일 때를 생각하자. 어떤 두 벡터 $x,\;y\in V$ 에 대하여 $T(x)=T(y)$ 이라면 정리 1.1-1(ⅲ)에 따라 $0=T(x)-T(y)=T(x-y)$ 이다. 따라서 $x-y\in N(T)$ 이고, 가정에 따라 $x-y=0$ 이다. 즉 $x=y$ 이므로 정리 0.1.1-1에 따라 $T$ 는 단사함수이다. $\square$

정리 2.2-2) 벡터공간 $V,\;W$ 와 선형변환 $T:V\to W$ 를 생각하자. $V$ 와 $W$ 모두 유한차원이고 서로 차원이 같다면 다음 세 명제는 동치이다.

(ⅰ) $T$ 는 단사함수이다.

(ⅱ) $T$ 는 전사함수이다.

(ⅲ) $\mbox{rank}(T)=\mbox{dim}(V)$

※ 전사함수에 대해서는 0.1.2. 전사함수 참고

proof)

(ⅰ$\Leftrightarrow$ⅲ) : $T$ 가 단사함수라고 가정하자. 정리 2.2-1에 따라 $N(T)=\{0\}$ 이므로 $\mbox{nullity}(T)=0$ 이며 차원정리에 따라 $\mbox{rank}(T)=\mbox{dim}(V)$ 이다. (참고: [벡터공간부터 기저까지] 정리 9.1-2 )

$\mbox{rank}(T)=\mbox{dim}(V)$ 라고 가정하자. 차원정리에 따라 $\mbox{nullity}(T)=0$ 이다. 즉 $N(T)=\{0\}$ 이므로 정리 2.2-1에 따라 $T$ 는 단사함수이다.

(ⅱ$\Leftrightarrow$ⅲ) : $T$ 가 전사함수라고 가정하자. 즉 $T$ 의 치역과 공역이 같아 $R(T)=W$ 이므로 $\mbox{rank}(T)=\mbox{dim}(W)$ 이다. 전제에 따라 $\mbox{dim}(W)=\mbox{dim}(V)$ 이므로 $\mbox{rank}(T)=\mbox{dim}(V)$ 이다.

$\mbox{rank}(T)=\mbox{dim}(V)$ 라고 가정하자. 전제에 따라 $\mbox{dim}(W)=\mbox{dim}(V)$ 이므로 $\mbox{rank}(T)=\mbox{dim}(W)$ 이다. $R(T)$ 는 $W$ 의 부분공간이므로 $R(T)=W$ 이다. (참고: [벡터공간부터 기저까지] 정리9.1-1 ) 따라서 $T$ 는 전사함수이다. $\square$

읽어주셔서 감사합니다.

이전 읽을거리 : [선형변환부터 동형사상까지] ch0. 함수

다음 읽을거리 : [선형변환부터 동형사상까지] ch2. 선형변환의 존재성 및 유일성

'수학 > 선형대수학' 카테고리의 다른 글

| [선형변환부터 동형사상까지] ch3. 선형변환의 행렬표현 (4) | 2021.07.22 |

|---|---|

| [선형변환부터 동형사상까지] ch2. 선형변환의 존재성 및 유일성 (0) | 2021.07.21 |

| [선형변환부터 동형사상까지] ch0. 함수 (0) | 2021.07.08 |

| [벡터공간부터 기저까지] ch3. 기저의 특성 (3) | 2021.06.08 |

| [벡터공간부터 기저까지] 부록. 공집합의 생성공간 (2) | 2021.06.01 |

댓글